Ifølge to ud af tre danskere bærer myndighederne det største ansvar for, at kunstig intelligens anvendes på en etisk ansvarlig måde. Samtidig frygter mere end hver fjerde, at der ikke udvikles tilstrækkelige retslige principper for kunstig intelligens, viser ny undersøgelse. Microsoft Danmark og DI ønsker nu et tættere samarbejde mellem techindustrien, danske virksomheder og Christiansborg om at tage fælles ansvar for udviklingen af kunstig intelligens.

Flere og flere danske virksomheder har de seneste år kastet sig over kunstig intelligens. Men hvad tænker befolkningen om udviklingen, og har de tillid til, at virksomheder og myndigheder bruger kunstig intelligens på en etisk ansvarlig måde?

”Det er i høj grad techvirksomhedernes ansvar, at folk får mere tillid til kunstig intelligens. Men for at nå dertil, kræver det mere politisk regulering og nogle klarere etiske rammer, som vi meget gerne vil samarbejde med myndighederne og erhvervslivet omkring”, siger Marianne Dahl Steensen, adm. direktør i Microsoft Danmark.

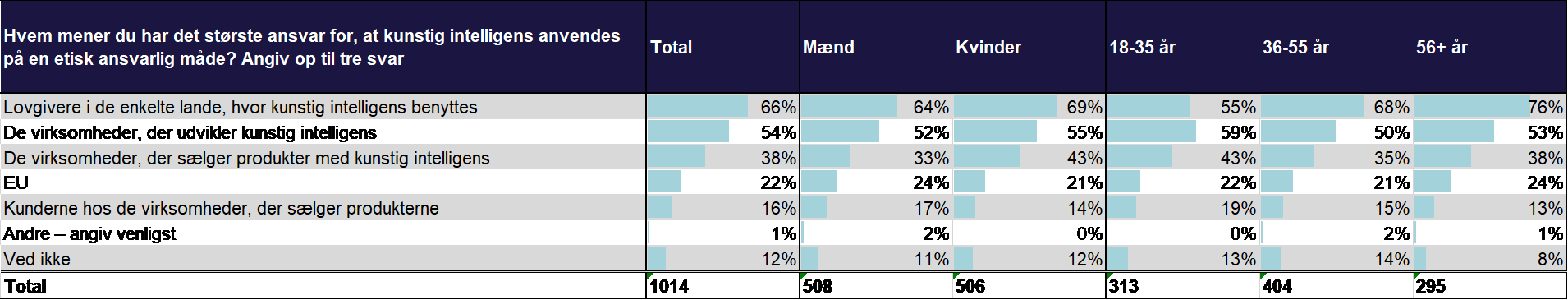

Mere end halvdelen af danskerne (54 %) mener, at techvirksomhederne selv bærer et etisk ansvar for, hvordan og til hvilke formål kunstig intelligens bliver anvendt. Men størstedelen (66%) mener, at ansvaret for kunstig intelligens først og fremmest hviler på myndighedernes skuldre i form af lovmæssig regulering. Det viser en ny undersøgelse foretaget af Microsoft Danmark.

Techvirksomhederne bør gå forrest

Ifølge Microsoft Danmark er der behov for mere regulering af udviklingen og anvendelsen af kunstig intelligens, og de står klar til et tættere samarbejde mellem erhvervslivet og Christiansborg for at sætte skub i reguleringsarbejdet.

”Det er i høj grad techvirksomhedernes ansvar, at folk får mere tillid til kunstig intelligens. Men for at nå dertil, kræver det mere politisk regulering og nogle klarere etiske rammer, som vi meget gerne vil samarbejde med myndighederne og erhvervslivet omkring. Det kunne til at starte med være at opstille en række politiske og etiske kriterier for udviklingen og anvendelsen af kunstig intelligens i Danmark,” siger Marianne Dahl Steensen, adm. direktør i Microsoft Danmark.

”Et eksempel er, hvor meget ansvar vi skal lægge i hænderne på teknologien, når alvorlige sygdomme skal diagnosticeres og behandles, eller når vi skal komme sikkert fra A til B med selvkørende transportmidler. De spørgsmål er det fuldstændig afgørende at have nogle klare etiske rammer for, hvis befolkningen skal have tillid til teknologien,” siger Marianne Dahl Steensen.

Danske virksomheder klar til at samarbejde

Også DI står klar til et skabe et tættere samarbejde mellem erhvervslivet og Christiansborg for at sætte skub i reguleringsarbejdet, så virksomhederne får nogle pejlemærker og klarere digitale rammer at arbejde ud fra.

”Virksomheder og myndigheder bør samarbejde om at sætte retning for udviklingen, så anvendelsen af kunstig intelligens sker til vores fælles bedste, og både beskytter det enkelte individ og giver værdiskabende nye forretningsmodeller,” siger Lars Frelle-Petersen, digital direktør i DI, og fortsætter:

”Kunstig intelligens rummer store potentialer og kommer til at ændre vores samfund. Derfor er det en fælles opgave at tage stilling til og ansvar for anvendelsen af kunstig intelligens. Det er os, og ikke teknologien, der skal have hånden på rattet.”

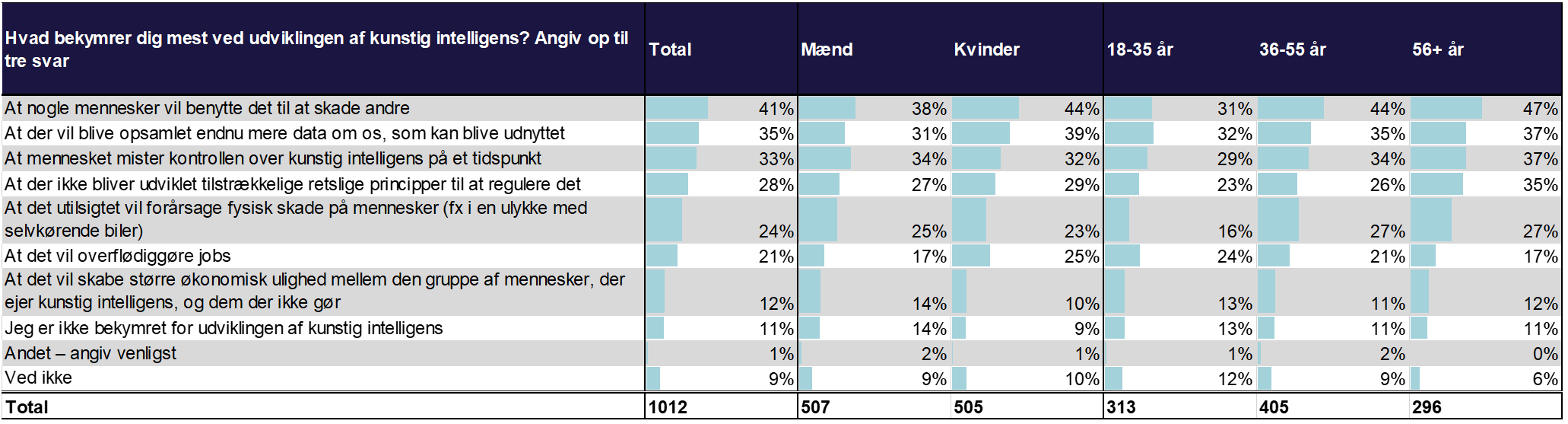

Undersøgelsen fra Microsoft viser også, at 23 % af danskerne finder udviklingen inden for kunstig intelligens bekymrende, mens 28 % frygter, at der ikke udvikles tilstrækkelige retslige principper for kunstig intelligens.

Microsofts seks etiske principper

Microsoft arbejder med seks etiske principper, som danner rammen for udvikling og anvendelse af kunstig intelligens. Et af kerneprincipperne er, at mennesker så vidt muligt skal træffe de afgørende beslutninger, og ikke computere eller robotter.

- Retfærdighed: Når kunstig intelligens hjælper os med at træffe beslutninger, skal det ske på fair vis og beslutningen må ikke foretages på basis af forudindtagede holdninger. For at sikre den retfærdighed er vi nødt til at forstå, hvordan menneskelige fordomme kan påvirke kunstig intelligens.

- Pålidelighed: Kunstig intelligens skal agere inden for klare rammer og på basis af meget grundige tests, så vi kan stole på, at systemet agerer på sikker vis ved uforudsete situationer, og at den kunstige intelligens ikke udvikler sig på en måde, som afviger fra den oprindelige tanke.

- Privatliv og sikkerhed: Ligesom andre cloud-baserede teknologier skal kunstig intelligens leve op til lovgivningen for beskyttelse af privatlivet, så personlige oplysninger bliver anvendt efter sikkerhedsstandarderne og er beskyttet mod cyberkriminalitet.

- Inklusion: Kunstig intelligens skal designes med inklusion for øje, så systemet tager højde for forskellige menneskers behov og forskellige brugsscenarier – herunder utilsigtede barrierer, som kan medføre eksklusion af enkelte mennesker eller gruppe.

- Gennemsigtighed: Efterhånden som kunstig intelligens får større indvirkning på vores liv, er vi nødt til at forstå konteksten for, hvordan den kunstige intelligens agerer, og hvordan systemet træffer beslutninger. Med denne gennemsigtighed kan vi bedre identificere forudindtagede holdninger, fejl og utilsigtet adfærd i systemet.

- Ansvarlighed: Mennesker, som designer og implementerer kunstig intelligens, er ansvarlige for, hvordan systemerne fungerer. Ansvarlighedsnormerne for kunstig intelligens bør række på erfaringerne fra andre områder som eksempelvis sundhedsområdet og privatlivssikker hed og bør evalueres såvel i designfasen som i den praktiske anvendelse.

——

For yderligere spørgsmål, kontakt Oliver William Gunner, pressechef hos Microsoft Danmark på [email protected] eller tlf. +45 28 56 23 22.

Om undersøgelsen

Radius har på vegne af Microsoft gennemført en befolkningsundersøgelse af danskernes holdninger til kunstig intelligens.

Analysen baserer sig på cirka 1.000 webinterviews af 18-75-årige danskere indsamlet via Userneeds panel i perioden den 21. juni – 27. juni 2018. Undersøgelsen er udsendt repræsentativt i forhold til køn, alder, region og uddannelse. Fuld repræsentativitet på de fire baggrundsvariable er sikret ved efterfølgende vægtning.

Tabelrapporten præsenterer de simple svarfordelinger med kryds på køn, alder, landsdele, om man har hjemmeboende børn, og hvor meget man ved om kunstig intelligens.