La carrera entre los científicos de la computación por crear el mejor sistema de visión por computadora del mundo parece más un maratón que un sprint.

El nuevo líder de la carrera es un equipo de investigadores de Microsoft en Beijing, el cual publicó un artículo académico hace unos días donde afirma que su sistema de visión por computadora, basado en redes celulares neuronales (CNN, por sus siglas en inglés), ha superado por primera vez la capacidad de la gente de clasificar objetos en el reto ImageNet 1000.

En su artículo, Delving Deep into Rectifiers: Surpassing Human-Level Performance on ImageNet Classification, los investigadores afirman que su sistema tuvo una tasa de error de 4.94% en el conjunto de datos de clasificación 1000-class ImageNet 2012, que contiene cerca de 1.2 millones de imágenes de entrenamiento, 50 mil imágenes de validación y 100 mil imágenes de prueba. En los experimentos anteriores, los humanos tuvieron una tasa de error estimada de 5.1%.

“Hasta donde sabemos, nuestro resultado es el primero en superar el desempeño humano en este reto de reconocimiento visual”, escribieron los investigadores.

El equipo de investigación está integrado por el investigador principal Jian Sun, de 38 años, por Kaiming He, un investigador de 30 años de edad que trabaja en el Grupo de Cómputo Visual de Microsoft Research, y por dos becarios académicos, Xiangyu Zhang, de la Universidad de Xi’an Jiaotong, y Shaoqing Ren de la Universidad de Ciencias y Tecnología de China.

Sun, quien ingresó a Microsoft Research Asia hace 12 años, cuenta con licenciatura, maestría y doctorado en Ingeniería Eléctrica de la Universidad de Xi’an Jiaotong, donde en el 2001 fue alumno de Harry Shum (@harryshum), vicepresidente ejecutivo de Tecnología e Investigación en Microsoft y miembro fundador del departamento de investigación de Microsoft en China. Shum, miembro IEEE y miembro ACM por sus contribuciones a la visión por computadora y a los gráficos de computadora, se siente sumamente orgulloso de los logros de su antigua alumno.

“El primer proyecto en el que Jian trabajó conmigo en el 2001, junto con el Profesor Nanning Zheng de la Universidad de Xi’an Jiaotong, fue la reconstrucción estéreo con propagación de creencia. Jian fue uno de los primeros en reconocer la ventaja de utilizar la propagación de creencia bayesiana para resolver una serie grande de problemas de visión por computadora con redes de Markov, tales como la visión estéreo”, dijo Shum.

Shum se siente especialmente orgulloso de los logros de Sun en Microsoft. “Muchos resultados de las investigaciones de Jian se han incorporado en los productos de Microsoft, y las posibilidades de su trabajo más reciente en redes neuronales más profundas es muy emocionante”.

Sun atribuye los últimos logros de su equipo a dos ideas principales: el desarrollo de unidades neuronales no lineales más adaptables en la red neuronal, y un mejor algoritmo de entrenamiento que hace más potente la red neuronal.

En su artículo académico, los investigadores observan que la neurona rectificadora es una de las varias ideas detrás del reciente éxito en la aplicación de redes neuronales profundas para resolver los problemas de visión por computadora.

“En este artículo investigamos las redes neuronales desde dos aspectos impulsados por los rectificadores”, escribieron los investigadores. “Primero, proponemos una nueva generalización del ReLU, la cual llamamos Parametric Rectified Linear Unit (Unidad Lineal Rectificada Paramétrica, o PReLU, por sus siglas en inglés). Esta función de activación aprende en forma adaptativa los parámetros de los rectificadores y mejora la precisión a un costo computacional adicional insignificante. Segundo, estudiamos la dificultad de entrenar los modelos rectificadores muy profundos. Al crear un modelo detallado de la no linealidad de los rectificadores (ReLU/PReLU), obtenemos un método de iniciación teóricamente sólido que ayuda con la convergencia de los modelos muy profundos (Ej., con 30 capas de peso) entrenados desde cero. Eso nos brinda más flexibilidad para explorar arquitecturas de red más potentes”.

Aunque les emociona que el algoritmo de su equipo supere la capacidad humana, al igual que otros investigadores en su campo, los autores del artículo aclaran que la visión por computadora aún es incapaz de igualar la visión humana, y señalan que el sistema de cómputo tiene problemas para entender los objetos y presenta dificultades en los casos en que se requiere tener un entendimiento contextual o un buen conocimiento de la escena.

“A pesar de que nuestro algoritmo produce un resultado superior en este conjunto de datos específico, no indica que la visión por máquina supere la visión humana en el reconocimiento de objetos en general. En cuanto al reconocimiento de categorías de objetos elementales, las máquinas aún presentan errores obvios en casos que son triviales para los humanos. No obstante, consideramos que nuestros resultados muestran el gran potencial de los algoritmos de máquina para igualar el desempeño humano en muchas tareas de reconocimiento visual”.

Con el Año Nuevo Chino (el año de la oveja) a celebrarse el 19 de febrero, Sun utiliza la oveja para explicar que la capacidad humana sigue estando mucho más desarrollada que la clasificación de imágenes por computadora.

“Los humanos no tienen problemas para distinguir entre una oveja y una vaca, pero las computadoras no son perfectas en estas tareas sencillas”, explica Sun. “Sin embargo, cuando se trata de distinguir entre diferentes razas de ovejas, las computadoras superan a los humanos. La computadora se puede entrenar para observar el detalle, textura, forma y contexto de la imagen y ver las diferencias que son imperceptibles para los humanos”.

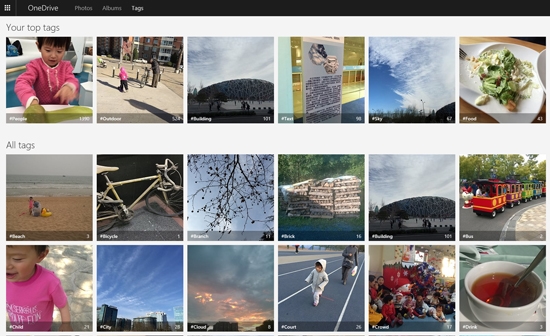

El trabajo de Sun, He y el equipo no se limita a la investigación; se está aplicando en los servicios de Microsoft, incluyendo la búsqueda de imágenes de Bing y OneDrive, la solución de almacenamiento en línea de la compañía. En un artículo de blog reciente, Douglas Pearce (@douglasprc), gerente de programas, expuso la manera en que OneDrive ahora puede reconocer automáticamente el contenido de tus fotos.

“Nuestros usuarios tendrán acceso a colecciones de fotos agrupadas de manera automática y podrán buscar fotografías específicas con facilidad. Podrán encontrar cosas al instante como ‘gente’, ‘perros’, ‘pizarrón’, ‘playa’, ‘atardeceres’, entre muchos otros términos. Esto simplificará aún más la tarea de agregar fotografías en las presentaciones escolares, revivir un momento memorable o compartir algo importante con todos tus amigos en Facebook”, dice Pearce.

Más adelante sugiere que los lectores interesados en cómo funciona esa tecnología lean el artículo que publicamos el pasado otoño sobre el trabajo de estos mismos investigadores, el cual consiste en acelerar los sistemas de aprendizaje profundo para detección de objetos hasta en 100 veces, sin dejar de ser precisos. Los adelantos del equipo se documentaron en el artículo de investigación titulado Spatial Pyramid Pooling in Deep Convolutional Networks for Visual Recognition.

“El equipo de Cómputo Visual aquí en Beijing está dedicado en su totalidad a evolucionar la visión por computadora, con el objetivo final de lograr que las computadoras emulen la capacidad perceptiva de los humanos. Me siento orgulloso de sus logros a través de los años, los cuales no solo han tenido un impacto positivo en el mundo académico con publicaciones de alta calidad, sino que también han beneficiado los productos de Microsoft mediante la transferencia de tecnología”, dijo Hsiao-Wuen Hon, presidente del Grupo de Investigación y Desarrollo en Microsoft Asia-Pacífico, y director de Microsoft Research Asia.

El maratón de visión por computadora cobró mayor fuerza en el 2010 cuando los científicos de las universidades de Stanford, Princeton y Columbia lanzaron el Reto de Reconocimiento Visual a Gran Escala. De acuerdo a un artículo del New York Times publicado en agosto del 2014 por el periodista especializado en la industria de tecnología, John Markoff (@markoff), la precisión casi se duplicó en la competencia del 2014 y las tasas de error se redujeron a la mitad. Más recientemente, los investigadores de Baidu publicaron un artículo académico donde afirman haber obtenido “una tasa de error de 5.33%” en el reto de clasificación de ImageNet.

El maratón continúa. El reto de este año tendrá lugar en diciembre. Pero eso no es el objetivo principal de Sun, He y el equipo. “Nuestro objetivo consiste en desarrollar sistemas de reconocimiento de objetos que sean tan buenos, o mejores, que los humanos en muchas aplicaciones útiles”, dijo Sun. “Para que eso suceda, necesitamos más datos de entrenamiento y más escenarios de prueba reales. Nuestro trabajo con Bing, OneDrive y otros servicios nos ayudará a fortalecer aún más nuestro algoritmo”.