Ciberseguridad

Cómo PhotoDNA for Video es utilizado para combatir la explotación infantil en línea

En el pasado, cuando alguien avisaba a la línea de reporte de contenido criminal de Internet Watch Foundation (IWF) acerca de un video en línea que pensaban incluía material de abuso sexual en niños, un analista en una organización no lucrativa en Reino Unido por lo general tenía que ver o avanzar todo el video para investigarlo.

Debido a que la gente que comparte videos de abuso sexual infantil por lo general integra este contenido ilegal en otro contenido que por lo general es inofensivo como películas de superhéroes, caricaturas o video casero, podría tomar 30 minutos o varias horas encontrar el contenido en cuestión y determinar si el video debería ser bajado y reportado a las fuerzas de la ley.

En 2017, la IWF, una organización global de vigilancia, comenzó a utilizar PhotoDNA, una herramienta que se desarrolló en un inició por Microsoft en 2009 para imágenes fijas, para identificar videos que habían sido señalados como material de abuso sexual infantil. Ahora, por lo general toma sólo un minuto o dos a un analista encontrar contenido ilegal.

Microsoft ahora pone a disposición PhotoDNA for Video de manera gratuita, y cualquier organización a nivel mundial que esté interesada en utilizar la tecnología puede visitar el sitio web de Microsoft PhotoDNA para aprender más, o para contactar al equipo.

“Ha hecho una enorme diferencia para nosotros. Hasta que tuvimos PhotoDNA for Video, debíamos sentarnos y cargar un video en un reproductor de medios y verlo hasta encontrar algo, lo que consume mucho tiempo”, comentó Fred Langford, director general adjunto en IWF, quien colabora con líneas telefónicas para reporte de abuso sexual en 45 países alrededor del mundo.

“Esto significa que podemos identificar y desactivar abuso sexual en línea y ayudar a las víctimas de manera más rápida”, comentó Langford.

“No queremos que este contenido ilegal sea compartido en nuestros productos y servicios. Y queremos poner la herramienta de PhotoDNA en tantas manos como sea posible para ayudar a detener la re-victimización”. – Courtney Gregoire, Unidad de Crímenes Digitales de Microsoft.

PhotoDNA for Video se basa en la misma tecnología empleada por PhotoDNA, una herramienta que Microsoft desarrolló con Dartmouth College que ahora es utilizada por cerca de 200 organizaciones alrededor del mundo para frenar la explotación sexual en niños. Microsoft aprovecha PhotoDNA para proteger a sus clientes de ser expuestos de manera inadvertida a contenido de explotación infantil, lo que ayuda a brindarles una experiencia en línea más segura.

PhotoDNA también ha habilitado a los proveedores de contenido a remover millones de fotografías ilegales de internet; ha ayudado a condenar a depredadores sexuales de niños; y en algunos casos, ha ayudado a las fuerzas de la ley a rescatar a víctimas potenciales antes de que hayan sido lastimadas de manera física.

Mientras tanto, sin embargo, el volumen de material con explotación sexual infantil que ha sido compartido en videos en lugar de imágenes fijas, se ha incrementado. El número de videos sospechosos reportados a CyberTipline, gestionada por el Centro Nacional para Niños Extraviados y Explotados (NCMEC, por sus siglas en inglés) en los Estados Unidos, se incrementó diez veces, de 312 mil en 2015 a 3.5 millones en 2017. Como es requerido por la ley federal, Microsoft reporta todas las instancias de material conocido de abuso sexual infantil al NCMEC.

Microsoft ha estado comprometido por largo tiempo a proteger a sus clientes de contenido ilegal en sus productos y servicios, y aplicar la tecnología que la compañía ya ha creado para combatir este crecimiento en videos ilegales era el siguiente paso lógico.

“El contenido en video de explotación infantil es una escena del crimen. Después de explorar el desarrollo de nueva tecnología y probar otras herramientas, determinamos que la tecnología PhotoDNA actual, que se utiliza de manera extensa, también podía ser utilizada para abordar videos de manera efectiva”, comentó Courtney Gregoire, asesora general adjunta con la Unidad de Crímenes Digitales de Microsoft. “No queremos que este contenido ilegal sea compartido en nuestros productos o servicios. Y queremos poner la herramienta PhotoDNA en tantas manos como sea posible para ayudar a detener la re-victimización de los niños que ocurre cada vez que un video aparece de nuevo en línea”.

Una encuesta reciente de sobrevivientes de abuso sexual infantil del Centro Canadiense para la Protección de Menores encontró que cuando se comparten imágenes y videos en línea que documentan crímenes cometidos contra ellos intensificaba sentimientos de vergüenza, humillación, vulnerabilidad e impotencia. Como mencionó un sobreviviente en el reporte: “El abuso se detiene y en algún punto también el miedo por el abuso; el miedo por el material nunca acaba”.

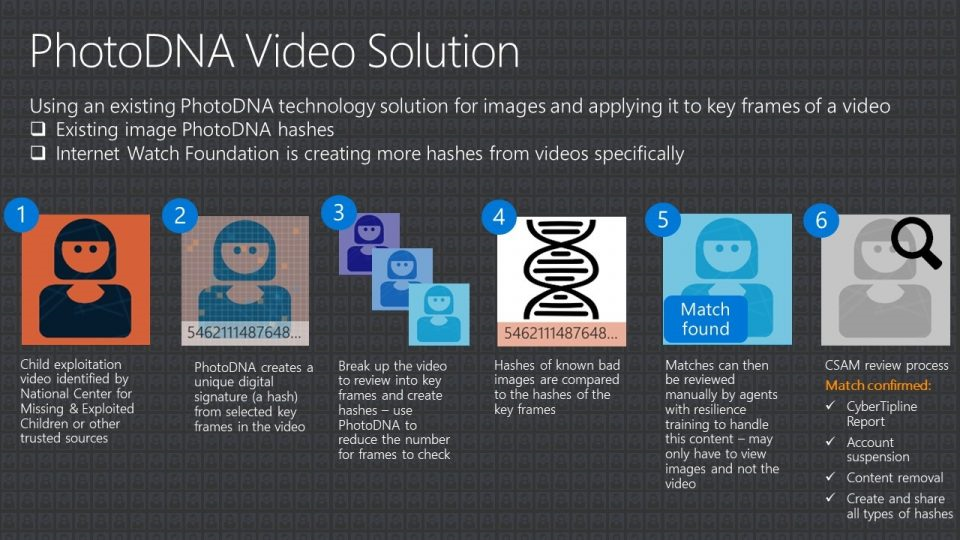

El PhotoDNA original ayuda a poner un alto a esta recirculación en línea con la creación de un “hash” o una firma digital de una imagen: la convierte en formato blanco y negro, la divide en cuadros y cuantifica ese sombreado. No emplea tecnología de reconocimiento facial, o puede identificar una persona o un objeto en la imagen. Compara el hash de la imagen contra una base de datos de imágenes que las organizaciones y compañías de vigilancia ya han identificado como ilegales. IWF, que ha compilado una base de datos de referencia de firmas de PhotoDNA, ahora cuenta con 300 mil hashes de materiales conocidos de explotación sexual infantil.

PhotoDNA for Video rompe un video en cuadros clave y en esencia, crea hashes para esas capturas de pantalla. De la misma manera que PhotoDNA puede relacionar una imagen que ha sido alterada para evitar la detección, PhotoDNA for Video puede encontrar contenido de explotación sexual infantil que ha sido editado o empalmado en un video que de otro modo podría parecer inofensivo.

“Cuando la gente incrusta videos ilegales en otros videos o trata de esconderlos en otras maneras, PhotoDNA for Video también puede encontrarlos. Sólo se necesita un hash de un solo cuadro para crear una relación”, comentó Katrina Lyon-Smith, gerenta técnica de programa, que ha implementado el uso de PhotoDNA for Video en los propios servicios de Microsoft.

Las organizaciones que ya utilizan una versión en sitio de PhotoDNA para remover imágenes ilegales serán capaces de agregar sin ninguna dificultad la capacidad de identificar videos. Microsoft también busca socios para que prueben la técnica de video en su PhotoDNA Cloud Service.

Herramientas automatizadas como PhotoDNA han hecho una gran diferencia en la lucha contra la explotación infantil en línea, en particular para compañías pequeñas que de otro modo no podrían tener la capacidad o el conocimiento de encontrar contenido ilegal en sus sitios web y aplicaciones, comentó Cecelia Gregson, fiscal del Condado King y abogada para la Fuerza de Tareas de Crímenes contra Menores por Internet de Washington.

Gregson estima que 90 por ciento de los casos que ella investiga ahora vienen de reportes de CyberTipline, enviados por compañías que utilizan PhotoDNA para mantener limpias sus plataformas. Bajo la ley federal, todos los proveedores de servicios de internet y de email deben reportar el conocimiento de pornografía infantil a la NCMEC.

“Ha hecho una enorme diferencia… Podemos identificar e interrumpir el abuso sexual en línea y ayudar a las víctimas de manera más rápida”. – Fred Langford, Internet Watch Foundation

“Esto no se trata de observar los patrones de compra en línea de alguien o de fotos familiares subidas. Buscamos archivos que muestren el abuso sexual a niños”, comentó Gregson. “Nos preocupa proteger a las víctimas infantiles, y también asegurarnos que los lugares en línea que visitan ustedes y sus niños no esté plagados con imágenes de abuso y explotación infantil. La tecnología también nos ayuda a identificar a depredadores sexuales de menores cuyas colecciones de imágenes pueden causar traumas fisiológicos, emocionales y mentales posteriores a sus víctimas”

Debido a que PhotoDNA y otras herramientas están disponibles de manera amplia, el número de reportes a CyberTipline de NCMEC ha crecido de un millón en 2014 a 10 millones en 2017, comentó John Shehan, vicepresidente para la división de menores explotados de NCMEC.

“Estas tecnologías permiten a las compañías, en especial a los proveedores de hospedaje, identificar y remover contenido sexual infantil de manera más rápida”, comentó Shehan. “Ese es un enorme beneficio público”.

Conozcan cómo detectar, remover y reportar materiales con abuso sexual infantil con PhotoDNA for Video, o contacten a [email protected]. Sigan @MSFTissues en Twitter.

Foto principal del Microsoft Cybercrime Center por Benjamin Benschneider.