[ブログ投稿日:2017年11月14日]

Posted by:ジョン ローチ (John Roach)

マイクロソフトの翻訳テクノロジを席巻する人工知能の新たな波が、より多くの言語で正確な音声認識を提供すると共に、マイクロソフトの翻訳テクノロジがサポートする 60 言語のすべてに対してより正確な機械翻訳を提供しています。

この開発成果は、11 月 16 日にオーストラリアで開催された Microsoft Tech Summit Sydney で発表されました。

テキストと音声翻訳のプラットフォーム Microsoft Translator の製品戦略担当ディレクター、オリビエ フォンタナ (Olivier Fontana) は「マイクロソフトには複雑なマシンがあり、あらゆる局面でイノベーションを行なっています」と述べ、AI の波が広がるにつれ、機械翻訳ツールによって、より多くの人がビジネスを成長させ、他者との関係を築き、異なる文化を体験できるようになると付け加えました。

マイクロソフトの世界中の研究所もこれらのテクノロジを活用して、人々による新しい言語の習得を支援しています。この例としては、今週のテックサミットで発表された中国語の非ネイティブスピーカー向けの学習アプリケーションなどがあります。

ニューラルネットワーク

Microsoft Translator の新たな進化は、昨年に行なわれたディープニューラルネットワークベースの機械翻訳への切り替えに基づくものです。これにより、過去の統計的機械翻訳と比較して、より流暢で人間的な翻訳が実現されます。

どちらの手法でも、プロフェッショナルが翻訳した文書を使用したアルゴリズムの訓練が必要です。これによってシステムはある言語で使用された単語やフレーズが、他の言語でどのように表現されるかを学べます。しかし、統計的手法では周辺の少数の言語によるローカルな文脈のみに基づいて翻訳するという制限があり、不自然で堅苦しい翻訳になりがちでした。

ニューラルネットワークはマルチリンガルの脳内のパターン認識処理の理論に触発されており、より自然な翻訳を実現します。

最近、マイクロソフトは 10 言語をニューラルネットワークベースの機械翻訳に切り替え、合計 21 言語の機械翻訳をニューラルネットワークベースにしました。機械翻訳の自動評価基準である BLEU (Bilingual Evaluation Understudy) のスコアでは、ニューラルネットワークベースの翻訳は正確性において言語ペアにより6パーセントから43パーセントの向上を示しました。

Microsoft AI and Research 機械翻訳チームのゼネラルマネージャーであるアルール メネゼス (Arul Menezes) は「過去 1 年間にわたり、マイクロソフトは対象言語を追加し、モデルの複雑性を増加してきました。これにより、品質は大きく向上しています」と述べ、マイクロソフトの翻訳サービスを使用する全開発者向けに、世界で広く利用されている言語であるヒンズー語と中国語のニューラルネットワークによる翻訳機能がデフォルトで提供されることを付け加えました。

翻訳プロセスのステップ

機械がある言語から別の言語に翻訳するプロセスは複数のステップに分割されます。それぞれのステップが翻訳の品質に影響を与えます。人が話す言葉を翻訳する場合には、最初のステップは音声認識、すなわち、話されている言葉のテキストへの変換になります。

マイクロソフトの音声翻訳テクノロジでサポートされるすべての言語は、音声認識に長期短期記憶と呼ばれるタイプのAIを使用しています。追加データを組み合わせることで、ディープニューラルネットワークモデルと比較して、会話において最大の29パーセントの品質向上が達成されました。

メネゼスは以下のように説明しています。「音声翻訳を行なう時には、まず音声認識を行ない、次に翻訳を行ないます。ゆえに、音声認識でエラーがあると次のステップでその影響が増幅されます。単語の聞き取りを間違えれば、翻訳は意味不明になってしまいます。」

機械翻訳の第二のステップでは、ある言語のテキストを別の言語のテキストに変換します。マイクロソフトはこのステップで 21 言語に対してニューラルネットワークベースのモデルを使用しています。言語ペアの一方だけがニューラルネットワークベースのモデルでサポートされている場合であっでも明らかな翻訳品質の向上が得られます。これは、英語を介して翻訳するというアプローチが採用されているからです。

たとえば、オランダ語からカタロニア語への翻訳の場合を考えてみましょう。オランダ語は新たにニューラルネットワークによりサポートされましたが、カタロニア語のニューラルネットワークのサポートはまだ開発中です。前述のハイブリッドなアプローチによりステップの半分が改善されることから、エンドユーザーはオランダ語からカタロニア語への翻訳の品質向上を認識できるとメネゼスは説明します。

音声翻訳の最後のステップでは、音声合成テクノロジにより翻訳されたテキストが音声に変換されます。ここでも、音声と言語分野の研究者は技術進化を達成しており、より正確で人間に近い合成音声が実現されています。これは、マイクロソフトの既存翻訳サービス全体の品質向上に加えて、新しい外国語学習機能の可能性を開きます。

中国語を学ぶ

外国語会話を学ぼうと思えば練習が不可欠です。ここでの課題は、発音、語彙、文法の練習に付き合ってくれる時間、忍耐力、技術を持った人を見つけることです。

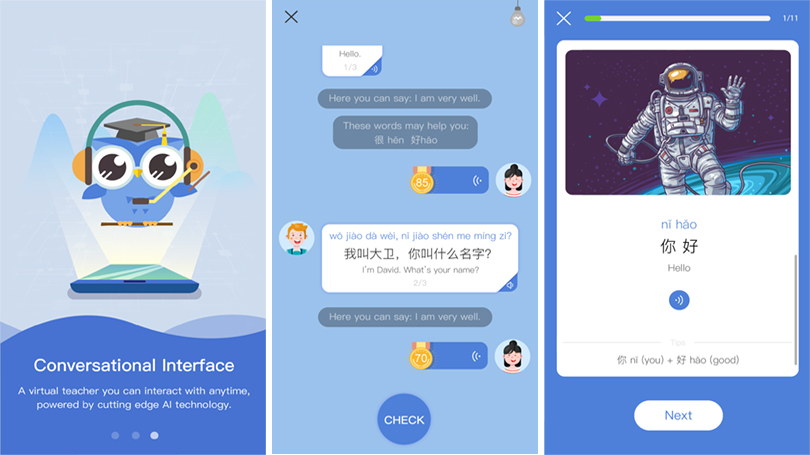

中国語を学ぶ人々のために、マイクロソフトはいつでも利用可能な人工知能ベースの外国語学習アシスタントとして機能する新しいスマートフォンアプリを開発し、このギャップを埋めることを目指しています。この無料アプリ Learn Chinese はまもなくアップルのiOSプラットフォーム上で提供されます。

このアプリは、多くの時間を費やして、混雑した教室で先生の発音を聴き、家でレッスンのビデオを見て、語彙や文法を学ぶために暗記カードを使って外国語を学習してきても、現実にネイティブスピーカーとの会話になると困難を抱えてしまう多くの学習者にとっての問題を解決することを目指しています。

北京の Microsoft Research Asia のシニアデベロップメントリードのヤン シャー (Yan Xia) は次のように説明します。「中国語がわかっているつもりになっても、実際に中国の人と対面で中国語を話そうとすると十分な練習がなければ何もできません。このアプリケーションはマイクロソフトの音声テクノロジを使用してこの問題に対応します。」

北京研究所の音声研究グループの主任研究員兼リサーチマネージャーのフランク スーン (Frank Soong) はこのアプリケーションが教師のアシスタントのようなものであると説明します。スーンは、Learn Chinese に加えて、2016 年に中国の WeChat プラットフォーム上で提供された英語学習のためのチャットボット Xiaoying の基盤となった機械学習モデルも開発しています。

「このアプリケーションは優れた人間の教師の代替ではありません。しかし、練習したい時にいつでも利用できることで教師を補完してくれます」とスーンは述べます。

この外国語学習テクノロジはディープニューラルネットワークなどの AI ツール群を活用しています。スーンのグループは、学習者が何を言おうとしているのかを理解し、発音、リズム、トーンを評価するためにニューラルネットワークのチューニングを行なってきました。ここでは、ネイティブスピーカーの発音、および、研究所の最先端の音声合成テクノロジに基づいて学習したモデルとの比較が行なわれます。

このアプリを使用すると、スコアによるフィードバックが得られ、改善の必要がある単語がハイライト表示され、正しい発音を聴くためのリンクが示されます。「このアプリは外国語学習のパートナーとして機能します。あなたの発音に反応し、フィードバックを提供してくれます」とシャーは述べています。

より多くの場所に

Learn Chinese アプリケーションとマイクロソフトの言語翻訳サービスのコア機能はクラウド上で稼働する人工知能によって支援されています。これにより、バス停、レストラン、イベント会場など、どこにいてもインターネット接続さえあれば、サービスにアクセスできるという柔軟性と利便性が得られます。

きわめて機密性が高い翻訳のニーズがあるお客様、および、インターネット接続がない場所でも翻訳サービスが必要なお客様に向けて、マイクロソフトはオンプレミスサーバ上でもニューラルネットワークベースの機械翻訳を提供しています。フォンタナによれば、この開発成果は「AI の波が進化し、より多くの場所とより多くの言語をサポートできる」ようになっている実例です。

—

本ページのすべての内容は、作成日時点でのものであり、予告なく変更される場合があります。正式な社内承認や各社との契約締結が必要な場合は、それまでは確定されるものではありません。また、様々な事由・背景により、一部または全部が変更、キャンセル、実現困難となる場合があります。予めご了承下さい。