Por: Courtney Gregoire, directora de seguridad digital.

Cada año, el Día del Internet Seguro brinda la oportunidad de hacer una pausa y reflexionar sobre el estado de la seguridad en línea: qué tan lejos hemos llegado y cómo podemos continuar con las mejoras. Durante casi una década, Microsoft ha marcado la ocasión al publicar investigaciones sobre cómo las personas de todas las edades perciben y experimentan el riesgo en línea. El año pasado, destacamos la creciente importancia de la IA. Este año, en nuestra novena Encuesta Global de Seguridad en Línea, hemos profundizado para comprender cómo las personas ven y usan esta tecnología, además de qué tan bien pueden identificar el contenido generado por IA.

Nuestros hallazgos muestran que, si bien ha habido un aumento global en los usuarios de IA (el 51% la ha usado alguna vez en comparación con el 39% en 2023), las preocupaciones sobre la tecnología también han aumentado: el 88% de las personas estaban preocupadas por la IA generativa, en comparación con el 83% del año pasado. Además, nuestros datos confirman que las personas tienen dificultades para identificar el contenido generado por la IA, lo que puede amplificar los riesgos de contenido abusivo de la IA.

Anunciamos nuevos recursos para potenciar el uso responsable de la IA

En Microsoft, nos comprometemos a promover la IA de manera responsable para aprovechar sus beneficios. Para ello, es fundamental el trabajo que realizamos para construir una arquitectura de seguridad sólida y proteger nuestros servicios de abusos. Por desgracia, sabemos que la creación de contenido dañino es una de las formas en que la IA puede ser objeto de abuso, por lo que adoptamos un enfoque integral para abordar este problema. Ese enfoque incluye la concienciación y la educación del público, y la investigación de este año subrayó la necesidad de alfabetización mediática y orientación sobre el uso responsable de la IA. Sobre la base del lanzamiento de nuestro kit de herramientas de seguridad infantil el año pasado, nos complace anunciar nuevos recursos:

- Colaboración con Childnet: Estamos orgullosos de asociarnos con Childnet, una organización líder en el Reino Unido dedicada a hacer de Internet un lugar más seguro para los niños. Juntos, desarrollamos materiales educativos destinados a prevenir el uso indebido de la IA, como la creación de deepfakes. Estos recursos estarán disponibles para las escuelas y las familias, para proporcionar información valiosa sobre cómo proteger a los niños de los riesgos en línea. Esta asociación pone de relieve nuestro amplio enfoque para abordar los riesgos de las imágenes íntimas no consentidas (NCII, por sus siglas en inglés), incluso a través de la educación para los adolescentes.

- Minecraft “CyberSafe AI: Dig Deeper”: Estamos encantados de anunciar el lanzamiento de “CyberSafe AI: Dig Deeper”, un nuevo juego educativo en Minecraft y Minecraft Education que se centra en el uso responsable de la IA. Este juego está diseñado para involucrar a las mentes jóvenes y fomentar la curiosidad mientras enseña lecciones importantes sobre la IA en un entorno de juego seguro y controlado. Los jugadores se embarcarán en emocionantes aventuras, donde resolverán acertijos y desafíos que resaltan las consideraciones éticas de la IA y los preparan para navegar por escenarios de seguridad digital del mundo real en casa y en la escuela. Si bien el jugador no se involucra con la tecnología de IA generativa de manera directa a través del juego, trabajará a través de desafíos y escenarios que simulan el uso de la IA y aprenderá a usarla de manera responsable. “Dig Deeper” es la cuarta entrega de una serie de mundos CyberSafe de Minecraft creados en asociación con Xbox Family Safety que se han descargado más de 80 millones de veces.

- Guía de IA para adultos mayores: También nos enorgullece asociarnos con los Servicios de Tecnología para Adultos Mayores (OATS, por sus siglas en inglés) de AARP, cuyos programas y socios involucran de manera colectiva a más de 500 mil adultos mayores cada año con tecnología gratuita y capacitación en IA. Como parte de la asociación, OATS lanzó una Guía de IA para adultos mayores que ayuda a las personas de 50+ años a comprender los beneficios y riesgos de la IA, incluida la orientación sobre cómo mantenerse seguro. La capacitación del personal del centro de llamadas de OATS para manejar preguntas relacionadas con la IA también ayuda a aumentar la confianza de los adultos mayores en su capacidad para usar la tecnología y detectar estafas.

Pueden encontrar recursos adicionales para que los educadores ayuden a los estudiantes a navegar por el mundo digital aquí.

Una inmersión más profunda en los resultados de la Encuesta Global de Seguridad en Línea de este año

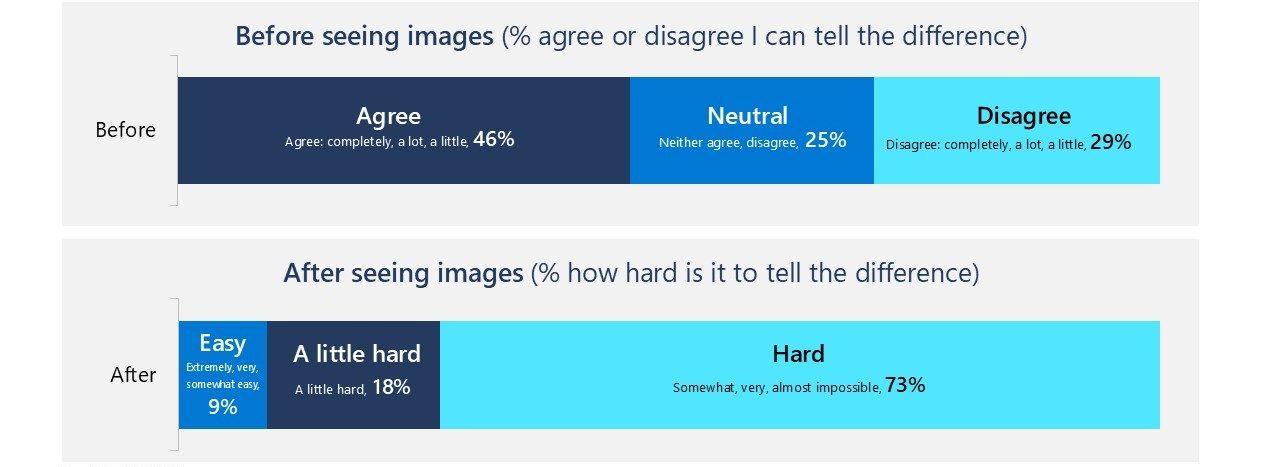

A medida que evoluciona el panorama digital, adaptamos las preguntas de nuestra encuesta global para reflejar estos cambios. Este año, identificamos una oportunidad para interrogar a las personas sobre su capacidad para identificar contenido generado por IA por medio de imágenes del cuestionario “Real or Not” (Real o No) de Microsoft. Preguntamos a los encuestados sobre su confianza en la detección de deepfakes antes y después de ver una serie de imágenes. Descubrimos que el 73% de los encuestados admitió que detectar imágenes generadas por IA es difícil, y solo el 38% de las imágenes se identificaron de manera correcta. También preguntamos a las personas sobre sus preocupaciones: las preocupaciones comunes sobre la IA generativa incluían estafas (73 %), abuso sexual o en línea (73 %) y deepfakes (72 %).

Nuestra investigación también muestra que las personas de todo el mundo continúan expuestas a una variedad de riesgos en línea, con un 66% expuesto a al menos un riesgo durante el último año. Pueden encontrar los resultados completos, incluidos datos adicionales sobre las experiencias y percepciones de la vida en línea de adolescentes y padres aquí.

Reafirmamos nuestro compromiso con la seguridad en línea

Nuestro enfoque en Microsoft se centra en empoderar a los usuarios mediante el avance de la seguridad y los derechos humanos. Sabemos que tenemos la responsabilidad de tomar medidas para proteger a nuestros usuarios de contenidos y conductas en línea ilegales y dañinos, así como de contribuir a un ecosistema en línea más seguro. También tenemos la responsabilidad de proteger los derechos humanos, incluidos valores fundamentales como la libertad de expresión, la privacidad y el acceso a la información. En Microsoft, logramos este equilibrio mediante la adaptación cuidadosa de nuestras intervenciones de seguridad en nuestros diferentes servicios al consumidor, en función de la naturaleza del servicio y del daño.

Nuestro enfoque para promover la seguridad en línea siempre se ha basado en la privacidad y la libertad de expresión. Abogamos por normas de seguridad proporcionadas y adaptadas, apoyamos los enfoques basados en el riesgo y advertimos contra las medidas demasiado amplias que obstaculizan la privacidad o la libertad de expresión. Continuaremos con la colaboración estrecha con los responsables políticos y los reguladores de todo el mundo para abordar los mayores riesgos, en especial para los niños, de manera reflexiva: el software de productividad como Microsoft Word, por ejemplo, no debería estar sujeto a los mismos requisitos que un servicio de redes sociales. Y, por último, continuaremos con la defensa de una legislación modernizada para proteger al público de los contenidos abusivos generados por la IA en apoyo de un entorno digital más seguro para todos.

Metodología de la encuesta global de seguridad en línea

Microsoft ha publicado una investigación anual desde 2016 que encuesta cómo las personas de diferentes edades usan y ven la tecnología en línea. Este último informe basado en los consumidores se basa en una encuesta de casi 15 mil adolescentes (de 13 a 17 años) y adultos que se llevó a cabo el verano pasado en 15 países, donde se examinan las actitudes y percepciones de las personas sobre las herramientas e interacciones de seguridad en línea. Las respuestas a la seguridad en línea difieren según el país. Se puede acceder a los resultados completos aquí.