ナターシャ・クランプトン (Natasha Crampton) AI 担当最高責任者

※本ブログは、米国時間 6 月 21 日に公開された ”Microsoft’s framework for building AI systems responsibly” の抄訳を基に掲載しています。

本日、マイクロソフトは、AI システムの開発基準のフレームワーク Responsible AI Standard を公表しました。これは、より優れた、より信頼できる AI を開発する取り組みを進めていく上で重要なステップです。マイクロソフトが、この基準を公表するのは、自分たちが今までに学んだことを共有し、他者からのフィードバックを求め、AI のより良い規範と実践の構築に向けた議論に貢献するためです。

より責任ある結果に導くための製品開発ガイドライン

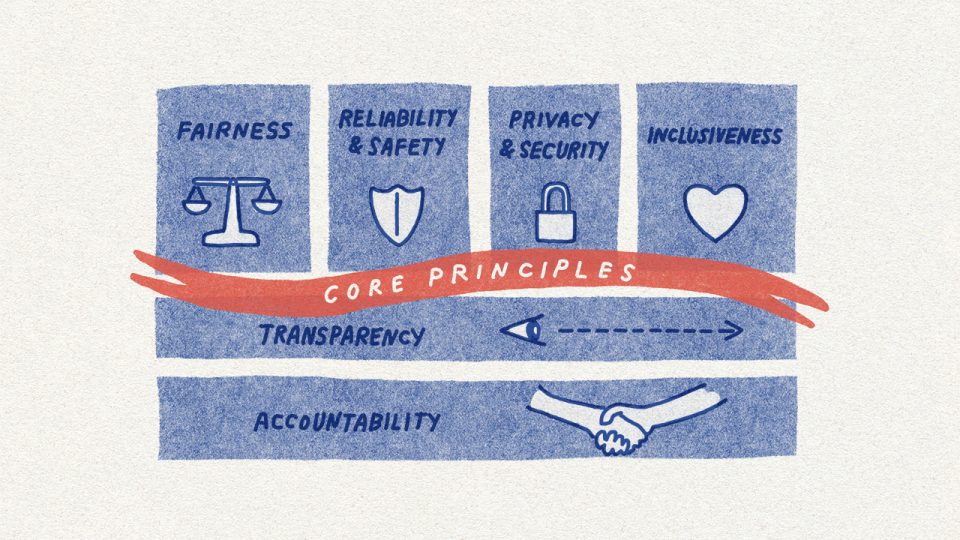

AI システムは、それを開発・展開する人々の様々な意思決定の産物です。システムの目的から、人と AI システムの関わり方まで、より有益で公平な結果を導くために、積極的にこれらの意思決定を行う必要があります。すなわち、人々とその目標をシステム設計の意思決定の中心に据え、公平性、信頼性と安全性、プライバシーとセキュリティ、包括性、透明性、説明責任といった長期的価値を尊重することが必要です。

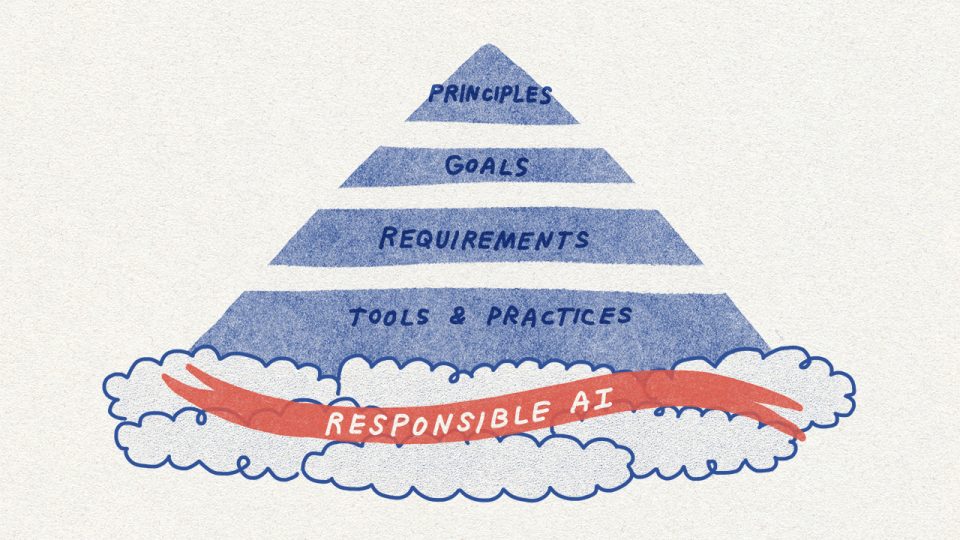

Responsible AI Standard は、これらの価値を守り、社会から信頼される AI システムをどのように構築すべきかについての、マイクロソフトの最善の考え方を示しています。この文書は、これまでの AI の世界で主流であった概要レベルの原則に留まらず、具体的で実行可能なガイダンスをマイクロソフトのチームに提供します。

この基準は、AI システムを開発するチームが実行すべき具体的な目標や成果を詳述しています。これらの目標は、「説明責任」のような広範な原則を、影響評価、データ ガバナンス、人的監視などの主要な実現項目に分解するのに役立ちます。そして、各目標は、AI システムがシステムのライフサイクルを通じて目標を達成するためにチームが取るべきステップである条件で構成されています。最後に、この基準は、利用可能なツールや実務を特定の条件をマップし、マイクロソフトの実装チームが成功を収めるためのリソースを提供します。

画像内: 原則、目標、条件、ツールと実務、責任ある AI

このような実践的なガイドラインの必要性が高まっています。AI が私たちの生活に浸透していく一方で、法律の整備は遅れていて、AI 特有のリスクや社会のニーズに追いつけていないのです。AI に対する政府の取り組みが広がる兆しが見える一方で、私たちにも行動を起こす責任があることを認識しています。マイクロソフトは、AI システムが、設計思想として責任あるものであることを保証するために取り組む必要があると考えています。

ポリシーの見直しと製品による経験からの学び

研究者、エンジニア、政策の専門家など、様々な分野の識者のグループが 1 年以上をかけて、Responsible AI Standard の第 2 版を作り上げました。これは、2019 年秋に社内で公開された第 1 版の基準を含む、マイクロソフトのこれまでの責任ある AI の取り組みに加え、最新の研究や製品での経験から学んだいくつもの重要な教訓に基づくものです。

音声テキスト化技術における公平性

社会の偏見や不平等を悪化させる可能性が、AI システムに関連する弊害として広く認識されています。2020 年 3 月のある学術研究では、ハイテク分野全般の音声テキスト化技術において、一部の黒人およびアフリカ系アメリカ人コミュニティのメンバーのエラー率が、白人ユーザーの約 2 倍であることが明らかになりました。この理由を熟考してみた結果、発売前のテストにおいて、様々な背景や地域の人々の会話の多様性を十分に取り込めていなかったことがわかりました。マイクロソフトは、この多様性の課題をより深く理解するために社会言語学の専門家と契約し、音声テキスト化技術の性能向上のためのデータ収集の取り組みを拡大するようにしました。その過程で、コミュニティから適切に、かつ敬意を持ってデータを収集する方法についての難しい課題に向き合う必要があることに気づきました。また、システムの性能のばらつきを説明する必要をよりよく理解するために、早い段階から専門家がプロセスに参加することの重要性も学びました。

Responsible AI Standard には、マイクロソフトが音声テキスト化技術を向上させる時にたどったパターンが記録されています。マイクロソフトは、この基準を全社的に展開していく中で、この基準で挙げられた「Fairness Goals (公正な目標)」と「Requirements (条件)」が、潜在的な公平性上の問題に先手を打って対応することに役立つと期待しています。

Custom Neural Voice と顔認識技術の適切な使用のコントロール

Azure AI の Custom Neural Voice も、オリジナルの音源とほぼ同じ合成音声を作成できる、マイクロソフトの革新的音声テクノロジです。AT&T はこのテクノロジを、受賞歴のある店舗内の Bugs Bunny 体験として活用しました。プログレッシブ社は、Flo の声をお客様とのオンラインのやり取りに導入しています。他にも多くのお客様の活用事例があります。このテクノロジは、教育、アクセシビリティ、エンターテインメントの分野で魅力的な可能性を秘めていますが、一方で、不適切ななりすましをしたり、聴き手を欺いたりするために使用されることも容易に想像できます。

マイクロソフトは、Responsible AI Standard で要求される Sensitive Uses のレビュー プロセスを含む Responsible AI プログラムを通じてこのテクノロジをレビューし、階層的管理フレームワークを採用することにしました。お客様からのアクセスを制限し、許容できるユース ケースを事前に定義し、Transparency Note と Code of Conduct を通じてそれを周知徹底し、合成音声を作成する際に話者の積極的な参加を確保するための技術的なガイドラインを確立しました。このような統制を通じて、テクノロジの有益な利用を維持しながら、悪用を防ぐことができました。

Custom Neural Voice での学びをもとに、顔認識サービスにも同様の統制を適用していきます。既存顧客に対する移行期間を経た後、これらのサービスへのアクセスを厳格に管理された顧客とパートナーに限定し、ユース ケースをあらかじめ定義された範囲内に絞り込み、サービスに組み込まれた技術的コントロールを活用していきます。

目的への適合性と Azure の顔認識機能

最後に、私たちは、AI システムが信頼に足るものであるためには、そのシステムが解決すべき問題に対して適切な解決策であることが必要であると認識しています。Azure Face Service を Responsible AI Standard の条件に適合させる作業の一環として、感情、および、性別、年齢、笑顔、顔面の毛、髪型、化粧などのアイデンティティ属性を推論する機能を廃止します。

感情のケースを例に取ると、人の顔をスキャンして、その表情や動きから精神状態を推測するようなテクノロジに対して、無制限の API アクセスを提供しないことにしました。社内外の専門家は、「感情」の定義に関する科学的コンセンサスの欠如、ユース ケース・地域・人口統計を横断した推論の一般化に関する課題、そして、この種の機能に関するプライバシーへの懸念の高まりなどを指摘しています。また、人の感情を推測する AI システムについては、表情解析などのテクノロジを使用しているか否かを問わず、すべてを慎重に分析する必要があると判断しました。Responsible AI Standard の Fit for Purpose Goal (目的に合わせた目標) と Requirements (条件) は、システム固有の有効性評価を事前に行うのに有効です。そして、Sensitive Uses のプロセスは、科学的根拠に基づき、影響力が大きいユース ケースに対して繊細なガイダンスを提供するのに役立ちます。

これらの実世界の課題は、マイクロソフトの Responsible AI Standard の開発に反映され、AI システムの設計、開発、導入の方法に確実に影響を与えています。

さらに詳しく知りたい方のために、Responsible AI Standard をサポートするための主要な資料も公開しています。たとえば、Impact Assessment テンプレートとガイド、そして、Transparency Notes があります。Impact Assessments は、マイクロソフトのチームが、AI システムの利害関係者、意図された利益、潜在的な有害性などの影響を、設計の初期段階で詳細に調査する上で有効であることが実証されています。Transparency Notes は、テクノロジの基本構成要素の機能と制限をお客様に開示し、お客様が責任を持って導入の選択をするために必要な知識を提供するための新たな形式の文書です。

画像内: 公平性、信頼性と安全性、プライバシーとセキュリティ、包括性、透明性、説明責任

中核的規範

多分野にわたる反復的な取り組み

最新の Responsible AI Standard は、マイクロソフトの様々なテクノロジ、職業、地域を横断する何百件ものインプットを反映しています。より実践的で具体的な内容となっているため、マイクロソフトの責任ある AI の実践に向けた大きな前進となります。また、危害を事前に特定し、測定し、軽減するための実用的なアプローチを定め、AI の有益な利用を保証し、悪用から守るための管理策を採用することをチームに求めています。本基準の開発に関する追加情報は、こちらのビデオをご参照ください。

この基準は、マイクロソフトの責任ある AI に向けた長期的取り組みにおける重要なステップですが、それは 1 つのステップに過ぎません。また、実装が進むにつれて、中断、反省、調整が必要な課題に遭遇することが予想されます。この基準は、今後も生きた文書であり続け、新たな研究、テクノロジ、法律、社内外からの学びを取り入れて、進化していきます。

組織が責任を持って AI を開発・展開するために、実行可能な基準をどのように作成すべきかについて、グローバルに活発な議論が行われています。マイクロソフトは、この議論から恩恵を受けており、継続的に貢献もしていきます。マイクロソフトは、産学官民が連携して最先端のテクノロジを進歩させ、互いに学び合うことが必要だと考えています。私たちは、共に未解決の研究課題の答えを見つけ、測定ギャップを解消し、新しい実務、パターン、リソース、ツールを設計していく必要があります。

より良い、より公平な未来には、AI の新しいガイドラインが必要です。マイクロソフトの Responsible AI Standard は、この目標に向け貢献し、マイクロソフトは全社を挙げてこの困難かつ重要な課題に取り組んでいます。マイクロソフトは、意義ある進歩を達成するために、オープン、誠実、そして透明でいることにコミットしていきます。

—

本ページのすべての内容は、作成日時点でのものであり、予告なく変更される場合があります。正式な社内承認や各社との契約締結が必要な場合は、それまでは確定されるものではありません。また、様々な事由・背景により、一部または全部が変更、キャンセル、実現困難となる場合があります。予めご了承下さい。