Сокращаем «пустыню данных»

Как сделать ИИ-системы инклюзивными

Сакиб Шайх рассказывает, что обычно незрячие люди, как и он сам, вырабатывают для себя четкий порядок, чтобы следить за своими вещами – каждый раз кладут ключи, бумажники, трости и другие предметы первой необходимости в одни и те же места.

Но иногда привычный порядок нарушается: ребенку нужно помочь найти затерявшуюся мягкую игрушку, мусорные баки во дворе оказываются не на своих местах, а все пальто на вечеринке свалены в одну кучу.

Сегодня человек, использующий приложение Microsoft Seeing AI, может направить камеру телефона в нужное место, например, на стол в конференц-зале, и услышать описание того, что окажется в кадре: ноутбуки, бутылки с водой, шнуры питания, телефоны. Но иногда и алгоритмам машинного обучения бывает полезно поучиться распознавать объекты, важные именно для конкретного человека, считает Шейх, инженер Microsoft, чья команда разработала приложение Seeing AI.

До недавнего времени соответствующих данных для обучения алгоритмов машинного обучения было недостаточно, чтобы справиться с такого рода персонифицированным распознаванием объектов для людей с нарушениями зрения. Вот почему Сити, Лондонский университет, получивший грант от программы Microsoft AI for Accessibility, запустил исследовательский проект Object Recognition for Blind Image Training (ORBIT) для создания публичного набора данных с нуля, используя видеоматериалы, предоставленные незрячими или слабовидящими людьми.

Эти данные будут использованы для обучения и тестирования новых алгоритмов, чтобы они могли распознавать и определять местонахождение личных предметов, которые для этого человека важны, от сотовых телефонов и защитной маски до кухонных принадлежностей.

«Без данных нет машинного обучения, – говорит Симона Стампф, старший преподаватель Центра проектирования взаимодействия человека и компьютера в Сити, Университет Лондона, которая возглавляет ORBIT. – И действительно, не существует доступного для всех набора данных такого размера, который позволил бы совершить качественное изменение в этой относительно новой области ИИ».

Отсутствие наборов данных для машинного обучения, которые представляют или включают людей с инвалидностью, не дает возможности исследователям или разработчикам успешно продвигаться в разработке интеллектуальных решений для повседневных задач. Также отсутствие таких данных не позволяет создавать системы искусственного интеллекта с меньшими искажениями, которые способны оказать влияние на процесс принятия решений.

«Мы находимся в информационной пустыне данных, – сказала Мэри Беллард, главный архитектор по инновациям Microsoft, которая также курирует программу AI for Accessibility. – У нас много желания и энергии создавать действительно классные вещи на базе ИИ для людей с инвалидностью, но у нас мало данных».

«Это как если у вас есть машина, вещи уже уложены, все готово, можно ехать, а бензина нет. Так и у нас – слишком мало данных, чтобы привести эти идеи в действие».

Чтобы сократить эту пустыню данных, исследователи компании Microsoft в течение последних полутора лет работают над изучением способов сделать системы искусственного интеллекта более инклюзивными для людей с инвалидностью. Компания также финансирует гранты программы AI for Accessibility и сотрудничает с грантополучателями для создания более репрезентативных наборов учебных данных, таких как ORBIT и инициатива Microsoft Ability Initiative совместно с исследователями Техасского университета в Остине.

В середине октября благотворительный фонд Team Gleason объявил о партнерстве с Microsoft по проекту Project Insight, который создаст открытый набор данных изображений лиц людей, страдающих латеральным амиотрофическим склерозом (ALS). Эта работа должна ускорить внедрение инноваций в области компьютерного зрения и более комплексно обучить соответствующие модели искусственного интеллекта.

В середине октября благотворительный фонд Team Gleason объявил о партнерстве с Microsoft по проекту Project Insight, который создаст открытый набор данных изображений лиц людей, страдающих латеральным амиотрофическим склерозом (ALS). Эта работа должна ускорить внедрение инноваций в области компьютерного зрения и более комплексно обучить соответствующие модели искусственного интеллекта.

Это общеотраслевая проблема, которая не может быть решена только одним проектом или организацией, говорит Microsoft. Но новые партнерства приближают нас к решению этой проблемы.

Дорожная карта исследований AI Fairness and Disability, опубликованная Microsoft Research, и семинар Disability, Bias and AI по вопросам инвалидности, искажения (вследствие нерепрезентативности) и ИИ, проведенный в прошлом году совместно с AI Now Institute при Нью-Йоркском университете, выявили множество потенциальных областей, в которых основные алгоритмы ИИ, не подготовленные по инклюзивным данным, либо не работают для людей с ограниченными возможностями, либо могут активно навредить им.

«Если алгоритмы обнаружения пешеходов в беспилотном автомобиле не были натренированы на примере людей, которые пользуются инвалидными креслами или чья поза или походка, например, в силу преклонного возраста отличаются от обычной, они могут неправильно идентифицировать этих людей как объекты. Это может помешать правильно оценить, сколько времени нужно, чтобы они могли безопасно перейти улицу», – отметили исследователи.

Модели искусственного интеллекта, используемые в процессах найма персонала, которые пытаются распознать личностные качества или интерпретировать эмоциональный настрой потенциальных кандидатов, могут неправильно истолковать сигналы и отсеять квалифицированных специалистов, страдающих аутизмом или проявляющих эмоции не так, как обычно. Алгоритмы, читающие почерк, могут не справиться с почерком людей с болезнью Паркинсона или с тремором. Системы распознавания жестов могут путаться, когда сталкиваются с людьми с ампутированными конечностями или другой, непривычной формой тела.

«Довольно часто люди с инвалидностью являются ранними приверженцами интеллектуальных технологий. Но зачастую они не совсем адекватно представлены в данных, сообщающих, как эти системы работают», – говорят исследователи.

«Когда технологии так нужны этим людям, они часто готовы мириться с бОльшим количеством ошибок, – говорит Мередит Рингель Моррис, старший научный сотрудник, которая руководит командой Microsoft по исследованию способностей. – Поэтому даже еще не до конца отработанные системы ИИ имеют ценность. Но они могли бы дать гораздо больше и работать гораздо лучше, если бы модели обучались на более инклюзивных данных».

«Подтолкнуть науку к совершенству»

Данна Гурари, грантополучатель программы AI for Accessibility и доцент Техасского университета в Остине, ставила для себя как раз эту цель, когда начала разрабатывать наборы данных VizWiz . Они включают в себя десятки тысяч фотографий и вопросов, которые слепые или слабовидящие люди отправили в приложение, изначально разработанное исследователями в Университете Карнеги-Меллона.

Вопросы были самые разнообразные: каков срок годности этого молока? О чем говорит эта сорочка? Выглядят ли мои пальцы синими? Судя по облакам, будет ли гроза? Готовы ли уже брикеты древесного угля в гриле? Что на поздравительной открытке?

Изначально приложение применяло краудсорсинг для получения ответов из Интернета. Но Гурари задалась вопросом, а можно ли использовать эти данные для улучшения интерпретации алгоритмами компьютерного зрения фотографий, сделанных слепыми людьми.

Ответы на многие из этих вопросов требуют прочитать текст, например, какую дозу лекарства, отпускаемого без рецепта, будет безопасно принять. «Исследования компьютерного зрения часто рассматривают это как отдельную проблему, отличающуюся, например, от распознавания объектов или попытки интерпретации низкокачественных фотографий. Но для успешного описания реальных фотографий требуется комплексный подход», – сказала Гурари.

Более того, алгоритмы компьютерного зрения как правило обучаются на больших наборах изображений, загруженных из Интернета. Большинство из них сделаны зрячими людьми и отражают интерес фотографа к предметам, которые находятся в центре и в фокусе.

Но алгоритм, который был обучен только на идеальных снимках, скорее всего, плохо описывает то, что на снимке, сделанном слепым человеком; он может быть размытым, откадрирован не по центру или сделан против света. Иногда вещь, о которой незрячий человек хочет узнать, зависит от детали, которую зрячий человек может даже не обозначить, например, чистая ли рубашка или грязная.

«Часто неясно, что именно имеет значение для людей, и поэтому так важно не просто создавать эти технологии, а создавать их вместе с незрячими или слабовидящими людьми», – сказала Гурари, которая также руководит группой по изображениям и видео Школы информации Техасского университета в Остине.

Ее команда взяла на себя масштабную задачу по очистке оригинального набора данных VizWiz, чтобы сделать его пригодным для тренировки алгоритмов машинного обучения – удаление неподходящих изображений, поиск новых этикеток, очистка личной информации и даже перевод аудиозапросов в текст, чтобы исключить возможность распознавания чьего-то голоса.

Сотрудничая с Microsoft, команда Гурари разработала новый общедоступный набор данных для обучения, проверки и тестирования алгоритмов на создание подписей на изображениях. Он включает в себя более 39 000 изображений, сделанных незрячими и слабовидящими участниками, и пять возможных подписей для каждого из них. Ее команда также работает над алгоритмами, которые могут сразу же распознать, когда представленное изображение слишком размыто, затемнено или плохо освещено, и посоветовать, как сделать еще раз.

Ранее в этом году компания Microsoft спонсировала открытый конкурс для исследователей других отраслей промышленности и науки, чтобы протестировать их алгоритмы создания подписей к изображениям в наборе данных VizWiz. В одной из распространенных метрик оценки самый высокоэффективный алгоритм показал улучшение на 33% по сравнению с предыдущим уровнем.

«Это действительно толкает науку вперед в создании субтитров для слепых», – сказал Шейх, ведущий разработчик ПО, который работает с ИИ для получателей грантов AI for Accessibility и их наборами данных для улучшения приложений.

Купюра 5 евро на красном столе.

Регулятор температуры печи, который в настоящее время находится в выключенном состоянии.

Коричневый цветочный горшок на окне с засохшими белыми и желтыми цветами

Человек, держащий в руках плюшевую игрушку динозавра из мультфильма.

Свежий банан, немного зеленый, но в основном желтый.

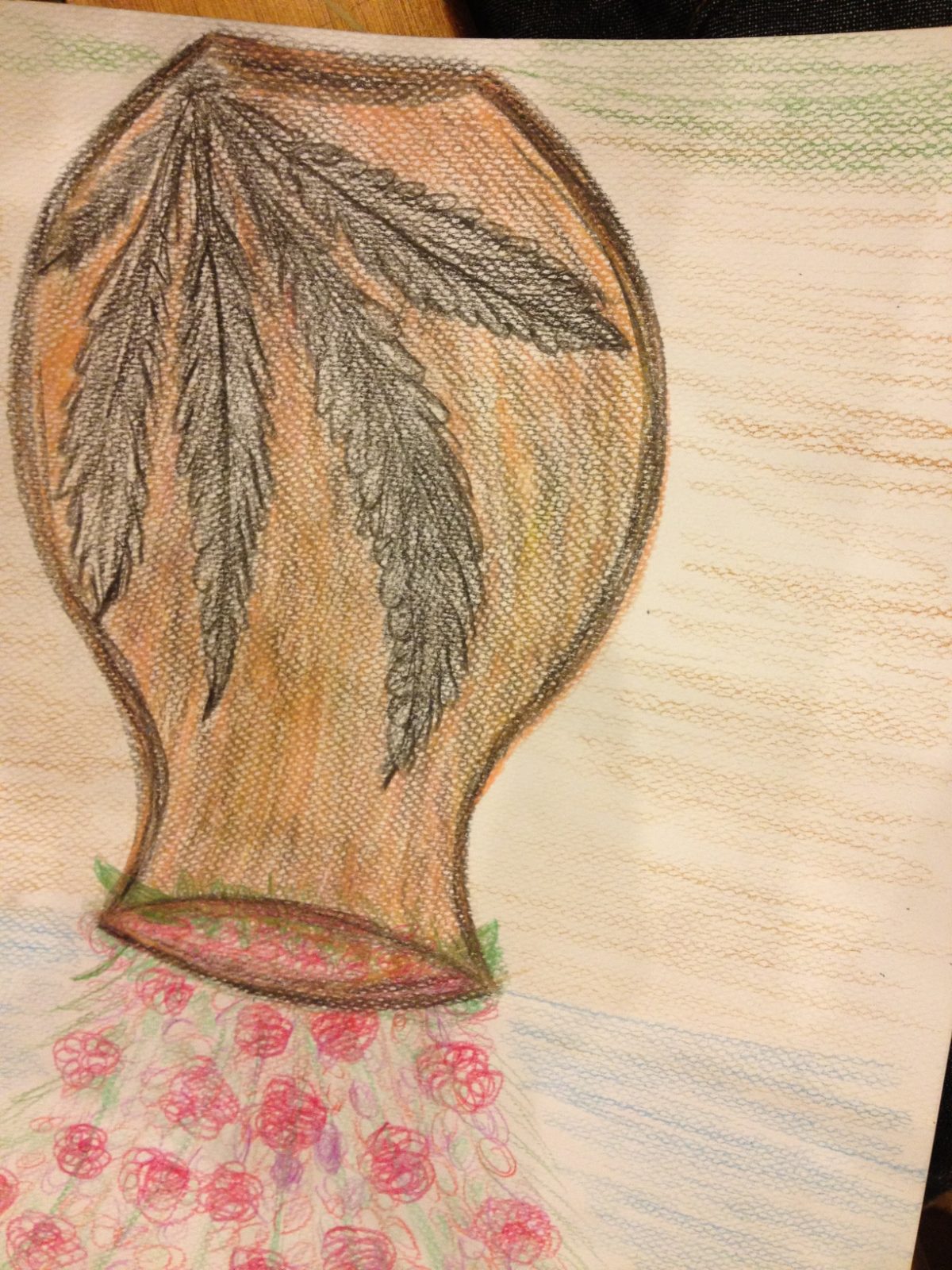

Рисунок вазы с цветами, раскрашенный карандашом

Набор данных VizWiz Image Captioning dataset содержит пять возможных подписей для каждого изображения, как эти примеры для каждой фотографии. Это помогает алгоритмам компьютерного зрения лучше научиться распознавать и описывать то, что отображается на фотографиях, сделанных слепыми или слабовидящими людьми. Фотографии доступны по лицензии Creative Commons 4.0.

Доступ к инклюзивным наборам данных для всех

Системы ИИ моделируют мир на основе данных, которые им дают. Если эти данные не отражают определенную группу людей, то эти люди могут игнорироваться или даже подвергаться активной дискриминации. Наряду с тем, что ИИ-сообщество все в большей степени признает необходимость работы над справедливым подходом этих систем в гендерных и расовых вопросах, разговоры об инклюзивности в отношении людей с инвалидностью, по словам исследователей, происходят все чаще.

Microsoft Research начала многоэтапную работу, чтобы определить глубину проблемы и наметить подходы к решению, которые рассматривались на семинаре, организованном совместно с AI Now Institute Нью-Йоркского университета. На семинаре собрались ученые и активисты, специалисты по машинному обучению, а также исследователи в области компьютерных наук. Участники заложили основы дискуссии по вопросам создания систем ИИ, которые позволяют избегать отношения к людям с ограниченными возможностями как к крайним случаям или отклонениям от нормы.

«Это четко указывает на вопрос о том, что системы искусственного интеллекта считают «нормальным», и кто должен это решать», – сказала Кейт Кроуфорд, старший научный сотрудник Microsoft Research в Нью-Йорке и соучредитель компании Fairness, Accountability, Transparency and Ethics (FATE, «Справедливость, подотчетность, прозрачность и этика») в группе ИИ.

«Возьмем пример прогностической системы найма персонала, которая оценивает видеоинтервью с кандидатами на работу и предлагает, как будет звучать и выглядеть «успешный» сотрудник, – сказала Кроуфорд. – Была ли эта система натренирована на данных, предполагающих, что определенные способности или способы бытия являются стандартными и поэтому желательными? Являются ли люди с инвалидностью или те, кто каким-либо образом отличается от других, менее предпочтительными для потенциального приема на работу, потому что они отличаются от данных в обучающем наборе? Это то, что мы должны знать и против чего мы должны работать».

Чтобы двигаться в направлении к этой цели, исследователи Microsoft решили изучить, как часто общедоступные наборы данных, обычно используемые для обучения систем искусственного интеллекта, включают данные людей старше 80 лет, поскольку возраст сильно коррелирует с инвалидностью. Моррис и ее коллеги изучают, как можно настроить алгоритмы поиска, чтобы улучшить результаты для людей с дислексией.

Прошлым летом компания Microsoft в качестве приглашенного исследователя принимала эксперта по технологиям для людей с инвалидностью Шона Кейна, доцента кафедры вычислительной техники Университета Колорадо-Боулдера. Целью приглашения было совместное изучение проблемы – как интеллектуальные системы восприятия могут не распознавать людей в инвалидных креслах или с ампутированными конечностями, двигательными нарушениями или морфологией тела, не входящими в число примеров, по которым эти алгоритмы были обучены.

Часто неясно, что имеет значение для людей, и именно поэтому так важно не просто создавать технологии для слабовидящих и незрячих, а создавать их вместе с ними.

Microsoft и грантополучатели программ изучают практические способы решения этих проблем и разрабатывают этические подходы к получению данных для обучения ИИ у людей с инвалидностью. Например, некоторые люди, которые беспокоятся о стигматизации или ответственности, не хотят раскрывать информацию о своем статусе, поэтому сохранение конфиденциальности имеет первостепенное значение.

Команда Стампф просматривает каждое видео, представленное в набор данных ORBIT, чтобы убедиться в отсутствии идентифицирующей информации. Они создали подробные инструкции о том, как снимать видео каждого предмета, потому что им нужны кадры с разных ракурсов, и люди должны были собирать данные без помощи зрячего человека.

На первом этапе проекта в Соединенном Королевстве команда собрала несколько тысяч видеозаписей, что сделало его самым крупным набором данных такого рода. В середине октября команда планирует открыть второй этап сбора данных по всему миру.

«Мы все еще работаем над тем, как сбалансировать получение хороших данных, с которыми можно внедрять инновации, и дать людям возможность быть движущей силой технологий, которые они будут использовать. При этом, процесс не должен быть слишком сложным или слишком зарегулированным, – сказала Сесили Моррисон, главный исследователь Microsoft Research Cambridge в Великобритании. – Если люди сочтут его трудным или скучным, они могут решить, что ИИ не для них».

Моррисон является соруководителем Project Tokyo, который направлен на помощь незрячим или слабовидящим людям осмыслить окружающую их среду. Она сотрудничает с командой Стампф по разработке алгоритмов, которые можно обучать на меньшем количестве примеров и которые могут иметь самое широкое применение.

По словам Стампф, перед ними стоит задача сделать набор данных ORBIT общедоступным, чтобы помочь улучшить как можно большее количество ситуаций повседневной жизни. Например, если слепой человек впервые посещает дом друга, навигационное приложение, которое полагается на систему GPS, может только приблизить их.

«Когда ты стоишь перед адресом, тебе все равно нужно знать, действительно ли это дом твоего друга или чей-то еще дом, – сказала Стампф. – Имея фотографии входной двери друга или других примечательных предметов, ты можешь использовать персонализированное распознавание объектов, которое позволит лучше определить важное для тебя место».

Видео Симоны Стампф (на английском языке)

Заглавное изображение: набор данных VizWiz включает фотографии, снятые слепыми людьми или людьми с ослабленным зрением, например, изображение мягкой игрушки и книги на покрывале для обучения алгоритмам компьютерного зрения. Фотографии доступны по лицензии Creative Commons 4.0 license.