AI Responsable

Construir IA de manera responsable desde la investigación hasta la práctica

La velocidad a la que las tecnologías de inteligencia artificial (IA) han mejorado en competencia y han pasado del laboratorio a las aplicaciones principales ha sorprendido incluso a los expertos en IA más experimentados. A pesar del progreso, la práctica de la IA aún es nueva y difícil de realizar. Esto crea una dinámica interesante: los profesionales de IA han comenzado a aprender nuevas habilidades de IA mientras crean aplicaciones de IA. Hay muchas oportunidades para aprender y mejorar.

Los principios de IA de Microsoft destacan las aspiraciones de diseñar nuestros sistemas de acuerdo con objetivos de equidad, confiabilidad y seguridad, privacidad y seguridad, inclusión, transparencia y responsabilidad. Pero los principios son sólo un punto de partida. En esta ocasión, en colaboración con Boston Consulting Group (BCG), presentamos pautas para líderes de productos diseñadas para ayudar a generar conversaciones importantes sobre cómo poner en práctica los principios de una IA Responsable (RAI). Esta guía es distinta de los procesos internos de Microsoft, pero refleja las perspectivas de ambas organizaciones.

También reconocemos que los principios y lineamientos deben considerar las realidades de la ingeniería. Necesitamos nuevos tipos de herramientas de ingeniería destinadas a ayudar a los desarrolladores de sistemas a comprender mejor y perfeccionar las tecnologías de IA. Uno de los desafíos que enfrentan los profesionales de la IA, tanto experimentados como inexpertos, es que los daños pueden surgir sin darse cuenta en las aplicaciones y los sistemas de IA. Los comportamientos adversos y las influencias de las aplicaciones de IA pueden variar de triviales a muy importantes. Las fallas pueden permanecer ocultas o solo descubrirse después de implementar las aplicaciones, porque se esconden en algoritmos, modelos, datos e incluso suposiciones. Puede ser una carrera contra el tiempo para mitigar los problemas.

Si bien ha habido un número creciente de herramientas y plataformas disponibles para ayudar a los profesionales a crear aplicaciones de IA, los instrumentos para ayudar a los ingenieros a descubrir qué podría salir mal son escasos. Hace varios años, nuestro equipo de Ética de la IA en Ingeniería e Investigación (Aether) y Microsoft Research reconocieron la necesidad de una nueva clase de herramientas y coordinaron y apoyaron su creación. La investigación de vanguardia ha sido importante para estudiar los desafíos de construir y desplegar sistemas de IA, reconocer lo que se debe hacer para construir IA de manera responsable y desarrollar métodos para abordar fallas potenciales.

Para llevar a la práctica los prometedores prototipos que construimos, nos basamos en las habilidades de investigación e ingeniería para desarrollar herramientas robustas y accesibles que puedan ser adoptadas por quienes más las necesitan. Nuestros esfuerzos han dado como resultado herramientas de código abierto para ayudar a los profesionales de ML a identificar problemas, diagnosticar causas y mitigar problemas antes de implementar aplicaciones. Estas herramientas incluyen:

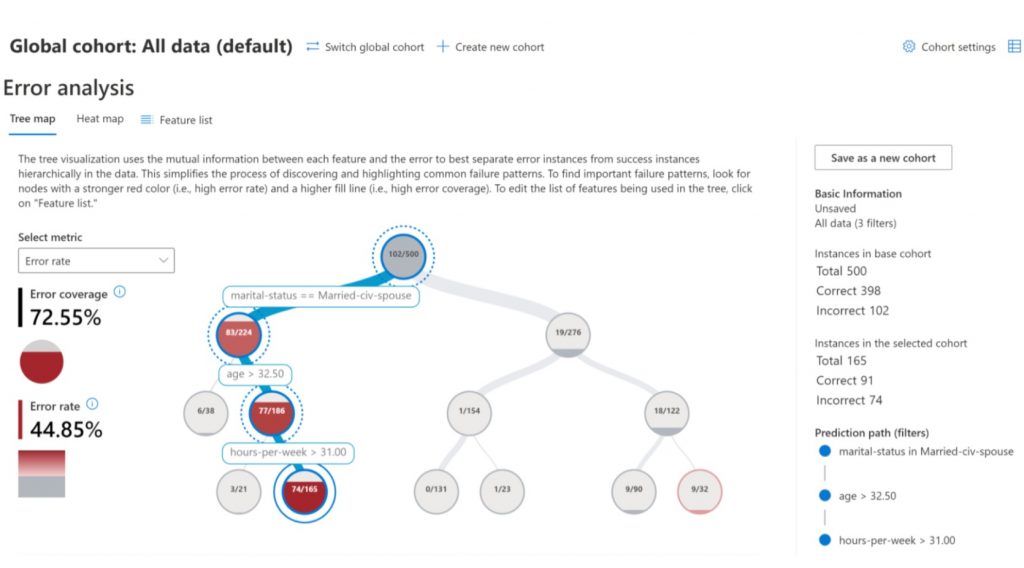

- Error Analysis: Analiza y diagnostica los errores del modelo

- Fairlearn: Evalúa y mitiga los problemas de equidad en los sistemas de IA

- InterpretML: Proporciona modelos de aprendizaje automático inspeccionables para mejorar la depuración de datos e inferencias

- DiCE: Permite el análisis contrafáctico para depurar predicciones individuales

- EconML: Ayuda a los tomadores de decisiones a deliberar sobre los efectos de las acciones en el mundo mediante la inferencia causal

- Kit de herramientas HAX: Guía a los equipos a través de la creación de experiencias colaborativas fluidas y responsables entre humanos y IA

Las herramientas siguen con su evolución. Ahora, también anunciamos el panel de control de IA Responsable (Figura 1) que muestra las funcionalidades de Error Analysis, Fairlearn, InterpretML, DiCE y EconML en un solo panel para ayudar a los desarrolladores de IA con la equidad, la interpretabilidad y la confiabilidad de los modelos de IA. Dentro del tablero, las herramientas pueden comunicarse entre sí y mostrar información en un lienzo interactivo para una experiencia de depuración y toma de decisiones de extremo a extremo.

Hemos conseguido un buen progreso en la comprensión y mitigación de problemas técnicos y sociotécnicos con la implementación de IA en el mundo abierto, pero hay mucho más por hacer. Pasar de los principios a las prácticas es difícil dadas las complejidades, los matices y la dinámica de los sistemas y aplicaciones de IA. No existen soluciones rápidas ni instantáneas que aborden todos los riesgos con aplicaciones de tecnologías de IA. Pero podemos avanzar a través de aprovechar lo mejor de la investigación y la ingeniería para crear herramientas destinadas al desarrollo y despliegue responsable de tecnologías de IA.

Los invitamos a conocer más sobre el panel de control de IA Responsable y contribuir a su desarrollo.

Conozcan más

- Evento Poner en práctica la IA responsable

- Diez pautas para que los líderes de productos implementen la IA de manera responsable

- Aprendizaje automático responsable

Foto principal: Foto cortesía de Microsoft.