信頼できる AI がより簡単に構築、運用できるように

バネッサ ホー (Vanessa Ho)

※本ブログは、米国時間 1 月 22 日にされた “Making easier for companies to build and ship AI people can trust ” の抄訳を基に掲載しています。

生成 AI は多くの業界に変革をもたらしていますが、技術が進化する中で、企業は安全かつセキュアな AI ツールの開発、展開に苦心しています。企業のリーダーは AI が誤った情報や有害な情報を生成したり、機密データを漏洩したり、攻撃者に悪用されたり、プライバシー法に違反したりするリスクを懸念しており、これらのリスクに対応する準備が整っていない場合もあります。

「多くの組織にとって、AI アプリケーションの品質や性能だけでなく、安全性やセキュリティも重要です。しかし、信頼できる AI を構築するために何をすればよいのか分からないか、それを実現するツールを持っていないことが多いのです」と、マイクロソフトで “責任ある AI” 部門 (Responsible AI) のチーフプロダクトオフィサーを務めるサラ バード (Sarah Bird) は語ります。

このような課題に応えるため、マイクロソフトはセキュリティ、安全性、プライバシーを重視した AI システムと、信頼のおける AI システムの構築と運用を支援するツールやサービスを提供しています。これらのツールは、多くの企業が複雑かつ厳しい規制が存在する環境でも AI 技術を導入する支援をします。たとえば、患者の医療記録を要約する AI アシスタントや、顧客に税務ガイダンスを提供する AI チャットボットなどがその例です。

責任ある AI 部門の主任プロダクトマネージャーである メヌーシュ サメキ (Mehrnoosh Sameki) は、このアプローチは開発者の効率向上にも貢献していると述べています。

本記事は、AI の導入における主な課題と、それに対するマイクロソフトの責任ある AI の実践やツールを通じた取り組みを紹介する 責任ある AI プラクティスの強化 シリーズの一環です。

「生成 AI アプリケーションの最初のバージョンを作成するまでは比較的容易ですが、リスクや法規制に関する懸念から、本番稼働前に大幅に作業が減速してしまいます。私たちのツールは、アプリケーションのテストや安全対策の過程を効率化し、安心して導入を進められるよう支援します」とサメキは説明します。

マイクロソフトはこれまで、自社製品のリスクを特定、測定、管理、監視するノウハウを蓄積し、その各プロセスが正しく機能させるための包括的な取り組みを進めてきました。責任ある AI ツールはその一環です。生成 AI が登場した当初、私たちはセキュリティや安全性、公平性などの分野の専門家を集め、基本的なリスクの特定とドキュメントの共有を始め、技術が進化する現在もこの取り組みは変わることなく続けられています。その後リスク軽減のための包括的なアプローチを開発し、それを実践するツールを開発しました。

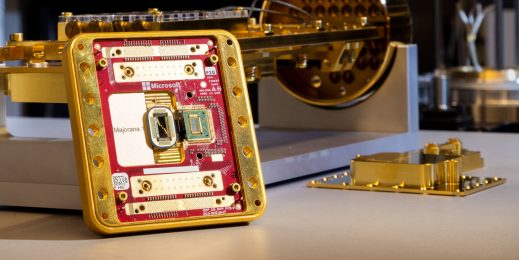

このアプローチには、ハルシネーションやプロンプト攻撃といったリスクに取り組むAI レッドチームの活動、ディープフェイクを研究する研究者、AI を評価するための測定システムを開発したエキスパート、そして安全な仕組みを構築・改良するエンジニア達のこれまでの成果が反映されています。ツールとしては、レッドチームがリスク特定に使うオープンソースフレームワーク PyRIT、リスクを継続的に測定、監視するAzure AI Foundry 上の自動評価システム、そして有害な入力や出力を検出・ブロックする Azure AI Content Safety などがあります。

また、アプリケーション用の適切なモデルの選択、システムメッセージの書き方、ユーザー体験設計に関するベストプラクティスも公開し、堅牢な AI 安全システムの構築をサポートしています。

「私たちは、さまざまなリスクに対処する複数の保護層から成る多層的な防御アプローチを採用し、そのすべての要素を誰もが活用できるよう提供しています」とバードは述べています。

例えば、税務ガイダンスチャットボットを構築した企業にとって、AI のハルシネーションを修正する機能は、正確な情報を提供する上で特に重要だった、とサメキは振り返ります。同時に、プロンプト攻撃や有害コンテンツ、個人情報をブロックするフィルターを導入することで、セキュリティ、安全性、プライバシーも向上させることができました。

信頼できるマイクロソフトの AI システムの構築は、私たちの活動の基盤です。そしてお客様自身でも信頼できる AI システムの構築が実現できるよう支援していきたいと考えています。チーフプロダクトオフィサー サラ バード

またサメキによると、医療記録要約アシスタントを開発した医療機関では、正確性を向上させるツールや、要約で重要情報が抜けることを防ぐカスタムフィルターの作成に特に関心がありました。

「多くのツールはデバッグツールとして役立ち、アプリケーションをどのように改善できるかを理解する助けになります」とサメキは語ります。「これらのツールを活用することで、両社とも迅速かつ自信を持って展開することができました。」

さらに、マイクロソフトは AI ガバナンスの向上も取り組んでいます。これは、アプリケーションやモデルの開発、展開、運用に関する重要な詳細を追跡、共有する仕組みです。Azure AI Foundry でプライベートプレビューとして提供される AI レポートは、増え続ける AI 規制への対応や評価に関する洞察、潜在的なリスクや軽減策を文書化するための統一プラットフォームを提供します。

「すべての要素が機能しているかを確認するためには、適切なガバナンスが必要です」とバードは述べています。「私たちはマイクロソフトの AI システムを規制に正しく準拠させながら、お客様のコンプライアンスを支援するベストプラクティス、ツール、技術も共有していきます」。

この取り組みは、すべての人が AI を活用してより多くのことを達成し、ラーニングを共有することでより業務を簡単にするというマイクロソフトの目標の一環です。

「信頼できるマイクロソフトの AI システムの構築は、私たちの活動の基盤です。そしてお客様自身でも信頼できる AI システムの構築が実現できるよう支援していきたいと考えています」と バード は語ります。

マイクロソフトの責任ある AI に関する取り組みについて、詳しくは Microsoft’s Responsible AI work をご覧ください。

—

本ページのすべての内容は、作成日時点でのものであり、予告なく変更される場合があります。正式な社内承認や各社との契約締結が必要な場合は、それまでは確定されるものではありません。また、様々な事由・背景により、一部または全部が変更、キャンセル、実現困難となる場合があります。予めご了承下さい。